|

wurden alle anderen hier beschriebenen Versuche mit festem  -Wert

durchgeführt. Ein Wert von 0,0001 hat sich für die bisherigen Trainingsmengen mit 10

bis 100 Beispielen bewährt. Versuche mit kleineren Werten brachten kaum

noch eine Verbesserung, deutlich größere Werte verschlechterten dagegen den

Lernerfolg. -Wert

durchgeführt. Ein Wert von 0,0001 hat sich für die bisherigen Trainingsmengen mit 10

bis 100 Beispielen bewährt. Versuche mit kleineren Werten brachten kaum

noch eine Verbesserung, deutlich größere Werte verschlechterten dagegen den

Lernerfolg.

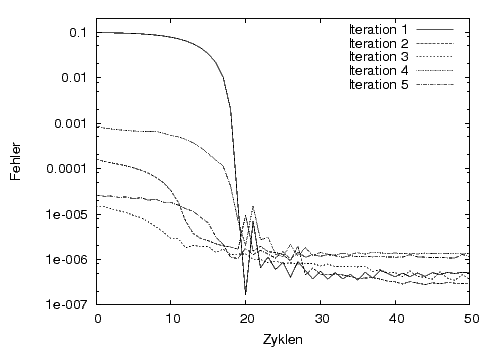

12.4.3. Iteratives TrainingBei iterativem Training gibt es mehrere Parameter, die geeignet gesetzt werden müssen. Die Anzahl der Trainingszyklen pro Iteration ist wichtig für die Effizienz und den Erfolg des Trainings. Wählt man zu viele Zyklen, so wird zu lange auf Daten trainiert, die nicht mehr aktuell sind. Durch die veränderten Gewichte können neue relative Beispiele enstehen und sich die aus den Beispielen erzeugten Trainingsdaten ändern, da sich die bestbewertete Tempovariante der Notenzuordnungen ändern kann. Wurde zu lange auf alten Daten trainiert, müssen die Gewichte in jeder Iteration wieder stark verändert werden. Für die Effizienz ist es aber auch wichtig, nicht mehr Generierungen von relativen Beispielen durchführen zu müssen als nötig, da die Auswertung aufwendig ist. Ein Wert von 50 Trainingszyklen hat sich bewährt, da sich die Gewichte nach dieser Zahl von Zyklen meist stabilisiert haben. In Abbildung 12.6 ist die typisches Beispiel für die Entwicklung des Fehlers im Verlauf einiger Iterationen dargestellt. Man sieht deutlich, daß die Fehlerwerte jeweils zu Beginn der Iterationen stark schwanken und sich nach etwa 30 Zyklen nur noch langsam ändern.

|