|

bewertete, die als

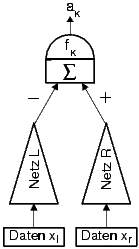

Eingabe an das linke bzw. rechte Netz angelegt werden. Die Netzeingabe des

Komparatorneurons netK ist dann y(xr) - y(xl), wobei y die durch das Netz N

berechnete Funktion bezeichnet. Diese Funktion ist wegen des Weight-Sharings

für das linke und rechte Netz identisch. Für das Komparatorneuron kann als

Aktivierungsfunktion eine sigmoide oder eine semilineare Funktion fK(x) = max(x,0)

verwendet werden. Der Zielwert der Aktivierung ist dann 0, denn es soll gelten

y(xl) > y(xr).

Das Komparatorneuron stellt zusammen mit dem linken und rechten Netz wieder

ein neuronales Netz dar und läßt sich mit einem Gradientenabstiegsverfahren

(Backpropagation bzw. RPROP) trainieren. Ziel des Trainings ist, für alle Paare die

relative Bewertung des Experten, d.h. eine Netzausgabe von 0 zu erreichen.

Ist nach dem Training der Fehler 0, so wurden alle Beispiele richtig bewertet,

d.h. die relative Bewertung widerspricht nicht der Vorgabe. Allerdings kann,

zumindest theoretisch, der Fall eintreten, daß y(xl) = y(xr) ist. Um dies zu

verhindern und um sicherzustellen, daß nicht Änderungen der Eingabe eine Änderung

der relativen Bewertung nach sich ziehen, wird zusätzlich y(xl) > y(xr) +

|