|

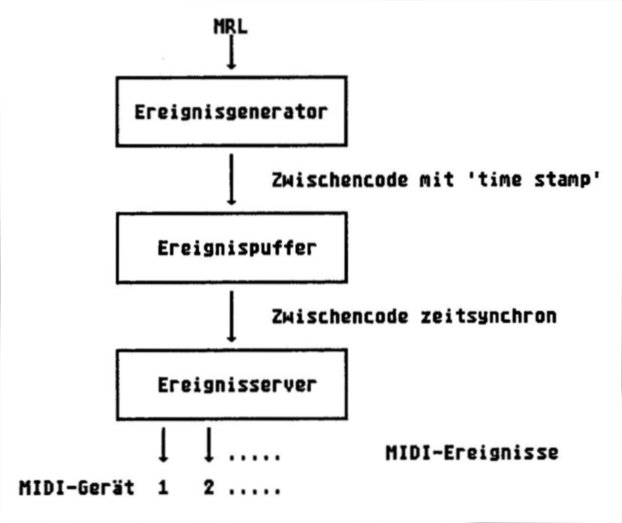

Ereignisse umsetzt. Die komplette Zeitsynchronisation ist dabei in der Interpretation des "sound"-Prädikates integriert. Die Implementation des "sound"-Prädikates wiederum besteht aus drei Teilen, einem Ereignisgenerator, einem Ereignispuffer und einem Ereignisserver:

Abbildung 1: Die Struktur des "sound"-Prädikates

Der Ereignisgenerator erzeugt asynchron aus der linearen musikalischen Struktur MIDI-Ereignisse (events). Diese werden an den Ereignispuffer weitergegeben, der für die korrekte zeitliche Reihenfolge der Ereignisse und für Synchronisation der Stimmen verantwortlich ist. Der Ereignisserver entnimmt die Ereignisse zu gegebener Zeit dem Puffer und sendet sie an ein MIDI-Gerät. Ereignisgenerator und Ereignisserver arbeiten als parallele Prozesse. In dem Augenblick, in dem für den ersten Zeitabschnitt alle Ereignisse (für alle definierten Stimmen) vorhanden sind, beginnt der Ereignisserver mit dem Senden der MIDI-Daten. Im allgemeinen generiert der Ereignisgenerator die Ereignisse schneller als sie vom Server abgearbeitet werden. Ist der Ereignispuffer voll, so wird der Generator angehalten. Dabei treten keine Zeitprobleme auf. Läuft der Ereignispuffer dagegen leer (etwa bei inkrementeller Ausgabe über den "sound"-Befehl), so sind Aussetzer zu hören. |